发布时间:2023-06-30

发布时间:2023-06-30 点击次数:

点击次数: 在大家不断升级迭代自家大模型的时候,LLM(大语言模型)对上下文窗口的处理能力,也成为一个重要评估指标。

比如 OpenAI 的 gpt-3.5-turbo 提供 16k token 的上下文窗口选项,AnthropicAI 的更是将 Claude 处理 token 能力提升到 100k。大模型处理上下文窗口是个什么概念,就拿 GPT-4 支持 32k token 来说,这相当于 50 页的文字,意味着在对话或生成文本时,GPT-4 最多可以记住 50 页左右内容。

一般来讲,大语言模型处理上下文窗口大小的能力是预定好的。例如,Meta AI 发布的 LLaMA 模型,其输入 token 大小必须少于 2048。

然而,在进行长对话、总结长文档或执行长期计划等应用程序中,经常会超过预先设置的上下文窗口限制,因而,能够处理更长上下文窗口的 LLM 更受欢迎。

但这又面临一个新的问题,从头开始训练具有较长上下文窗口的 LLM 需要很大的投入。这自然引出一个疑问:我们能否扩展现有的预训练 LLM 的上下文窗口?

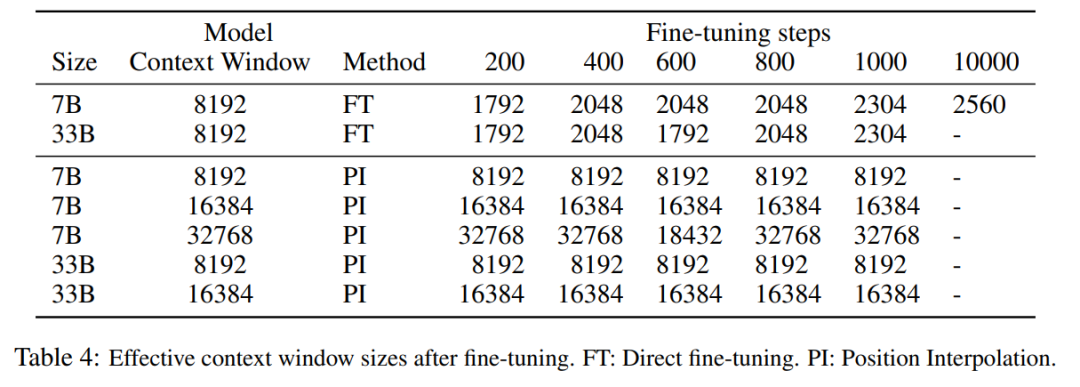

一种直接的方法是对现有的预训练 Transformer 进行微调,以获得更长的上下文窗口。然而,实证结果表明,使用这种方式训练的模型对长上下文窗口的适应速度非常慢。经过 10000 个批次的训练后,有效上下文窗口的增加仍然非常小,仅从 2048 增加到 2560(实验部分的表 4 可以看出)。这表明这种方法在扩展到更长的上下文窗口上效率低下。

本文中,来自 Meta 的研究者引入了位置插值(Position Interpolation,PI)来对某些现有的预训练 LLM(包括 LLaMA)的上下文窗口进行扩展。结果表明,LLaMA 上下文窗口从 2k 扩展到 32k,只需要小于 1000 步的微调。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

图片

图片

论文地址:https://arxiv.org/pdf/2306.15595.pdf

ChatGPT Writer

ChatGPT Writer

免费 Chrome 扩展程序,使用 ChatGPT AI 生成电子邮件和消息。

106

查看详情

106

查看详情

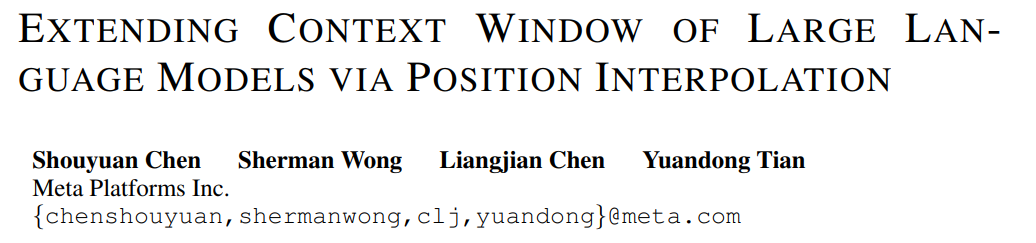

该研究的关键思想不是进行外推(extrapolation),而是直接缩小位置索引,使得最大位置索引与预训练阶段的上下文窗口限制相匹配。换句话说,为了容纳更多的输入 token,该研究在相邻的整数位置上插值位置编码,利用了位置编码可以应用于非整数位置的事实,与在训练过的位置之外进行外推相比,后者可能导致灾难性的数值。

PI 方法将基于 RoPE(旋转位置编码)的预训练 LLM(如 LLaMA)的上下文窗口大小扩展到最多 32768,只需进行最小的微调(在 1000 个步骤内),这一研究在需要长上下文的各种任务上性能较好,包括检索、语言建模以及从 LLaMA 7B 到 65B 的长文档摘要。与此同时,通过 PI 扩展的模型在其原始上下文窗口内相对保持了较好的质量。

在我们比较熟悉的 LLaMA、ChatGLM-6B、PaLM 等大语言模型中,都有 RoPE 身影,该方法由追一科技苏剑林等人提出,RoPE 通过绝对编码的方式实现了相对位置编码。

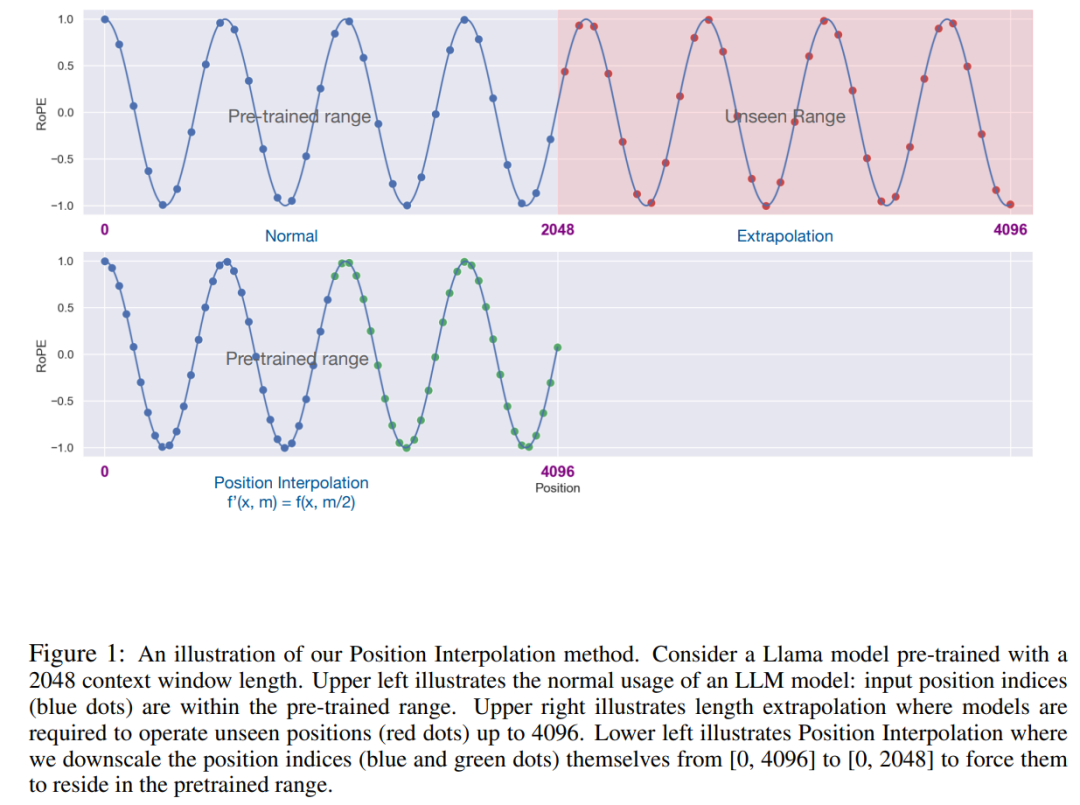

虽然 RoPE 中的注意力得分只取决于相对位置,但它的外推性能并不好。特别是,当直接扩展到更大的上下文窗口时,困惑度可能会飙升到非常高的数字 (即 > 10^3)。

本文采用位置插值的方法,其与外推方法的比较如下。由于基函数 ϕ_j 的平滑性,插值更加稳定,不会导致野值。

图片

图片

该研究将 RoPE f 替换为 f ′,得到如下公式

图片

图片

该研究将在位置编码上的转换称为位置插值。这一步将位置索引从 [0, L′ ) 缩减到 [0, L) ,以匹配计算 RoPE 前的原始索引范围。因此,作为 RoPE 的输入,任意两个 token 之间的最大相对距离已从 L ′ 缩减到 L。通过在扩展前后对位置索引和相对距离的范围进行对齐,减轻了由于上下文窗口扩展而对注意力分数计算产生的影响,这使得模型更容易适应。

值得注意的是,重新缩放位置索引方法不会引入额外的权重,也不会以任何方式修改模型架构。

该研究展示了位置插值可以有效地将上下文窗口扩展到原始大小的 32 倍,并且这种扩展只需进行几百个训练步骤即可完成。

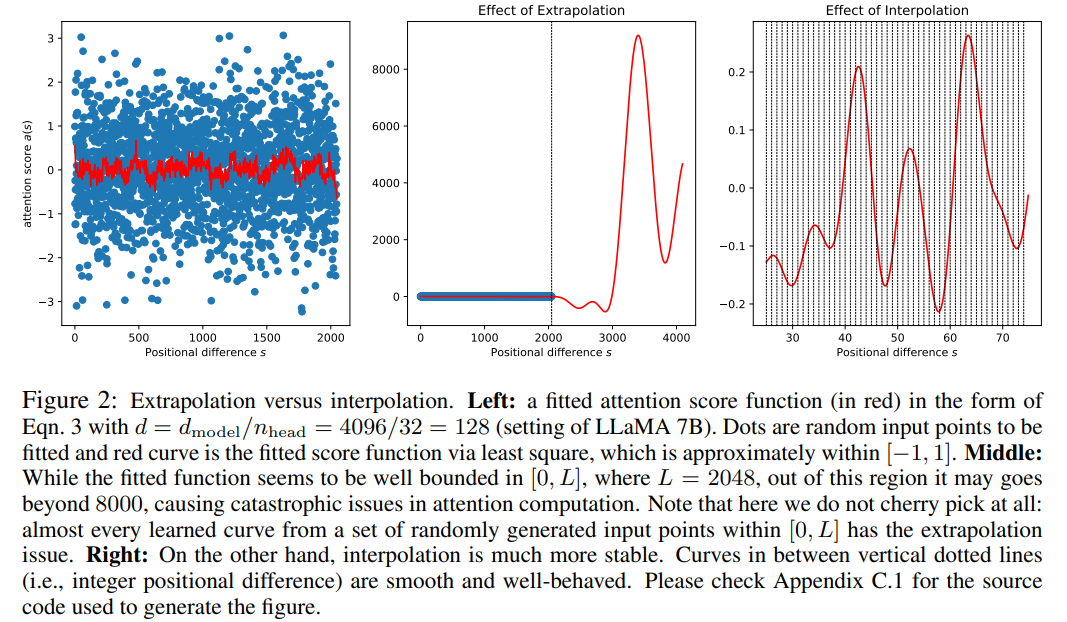

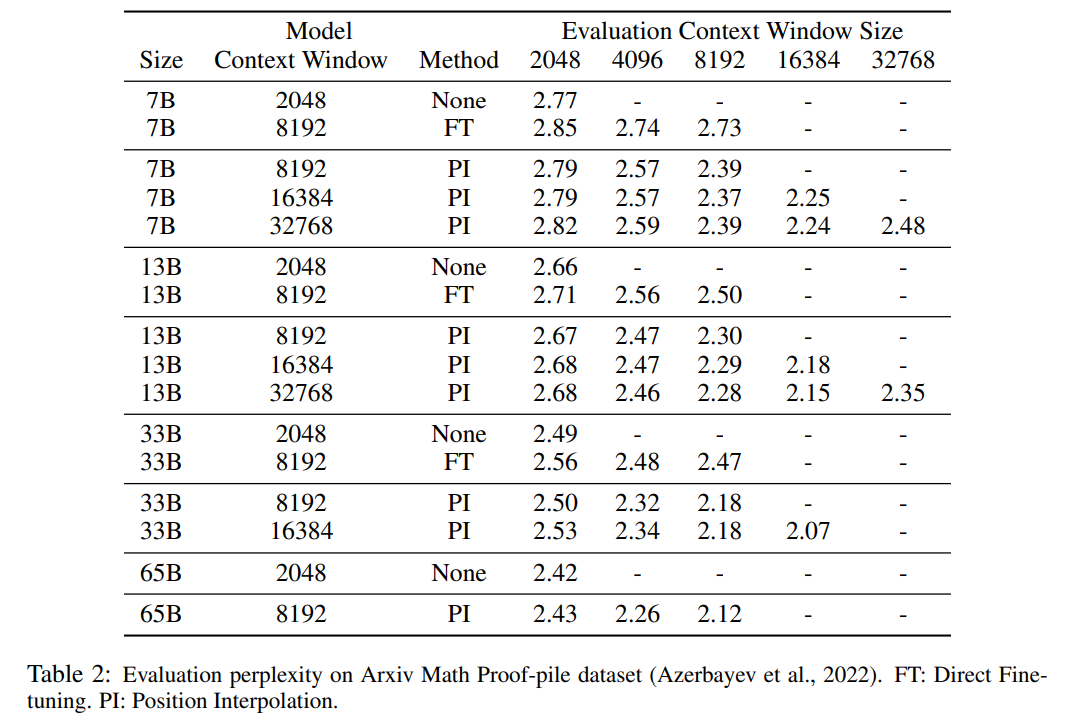

表 1 和表 2 报告了 PI 模型和基线模型在 PG-19 、 Arxiv Math Proof-pile 数据集上的困惑度。结果表明使用 PI 方法扩展的模型在较长的上下文窗口大小下显著改善了困惑度。

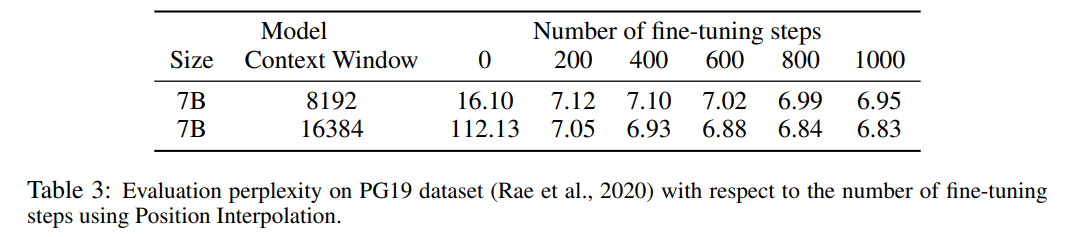

表 3 报告了在 PG19 数据集上使用 PI 方法,将 LLaMA 7B 模型扩展到 8192 和 16384 上下文窗口大小时的困惑度与微调步数之间的关系。

由结果可得,在没有微调的情况下(步数为 0),模型可以展现出一定的语言建模能力,如将上下文窗口扩展到 8192 时的困惑度小于 20(相比之下,直接外推方法的困惑度大于 10^3)。在 200 个步骤时,模型的困惑度超过了 2048 上下文窗口大小下原始模型的困惑度,表明模型能够有效利用比预训练设置更长的序列进行语言建模。在 1000 个步骤时可以看到模型稳步改进,并取得了更好的困惑度。

图片

图片

下表表明,通过 PI 扩展的模型在有效上下文窗口大小方面都成功地实现了扩展目标,即仅通过微调 200 个步骤后,有效上下文窗口大小达到最大值,在 7B 和 33B 模型大小以及最高 32768 上下文窗口的情况下保持一致。相比之下,仅通过直接微调扩展的 LLaMA 模型的有效上下文窗口大小仅从 2048 增加到 2560,即使经过 10000 多个步骤的微调,也没有明显加速窗口大小增加的迹象。

图片

图片

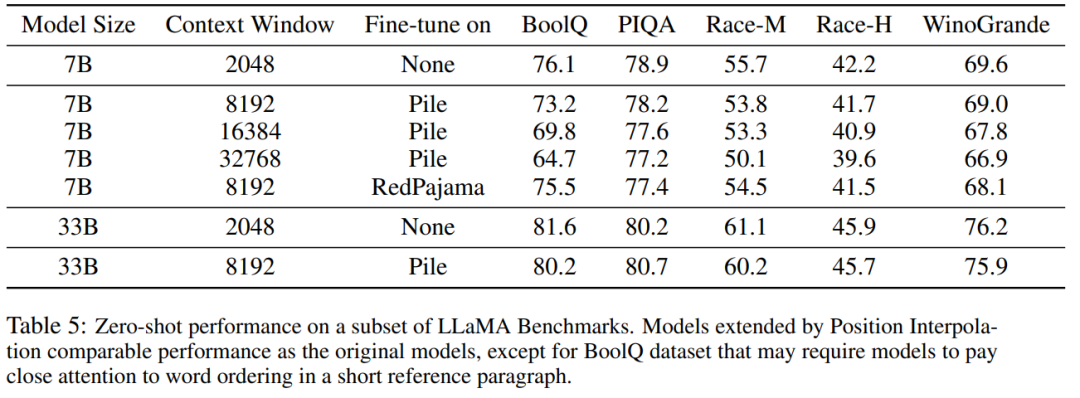

表 5 显示扩展到 8192 的模型在原始基准任务上产生了可比较的结果,而该基准任务是针对更小的上下文窗口设计的,对于 7B 和 33B 模型大小,在基准任务中的退化最多达到 2%。

图片

图片

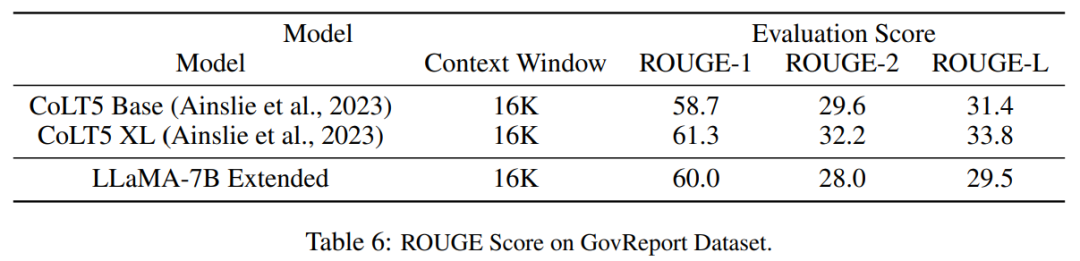

表 6 表明,具有 16384 上下文窗口的 PI 模型,可以有效地处理长文本摘要任务。

图片

图片

以上就是田渊栋团队新研究:微调的详细内容,更多请关注其它相关文章!

# 有效地

# 兰州哪里可以做网站建设

# 淮北网站推广营销招聘

# 南阳seo效果推广分类

# 东莞抖音seo技术公司

# 网站优化相关知识

# 亚马逊总的关键词排名

# 美工网站建设的好处

# 安庆网站推广策划方案

# 百度seo规则

# 最好网站建设平台

# 较长

# 模型

# 较好

# 只需

# 丰田

# 中国科学院

# 更长

# 最多

# 插值

# 扩展到

# llama

# claude

# meta

相关栏目:

【

行业新闻62819 】

【

科技资讯67470 】

相关推荐:

人形机器人概念大热!这些产业链标的或受提振

360发布数字安全和人工智能的强大结合:360安全大模型

丰田汽车研究院推出生成式人工智能汽车设计工具

数字彩排、虚拟建厂!这家顶级洗衣机工厂敲开“工业元宇宙”之门

英伟达推出 L40S GPU,AI 推理性能超过 A100 约 1.2 倍

给小朋友最好的科技礼物:乐天派桌面机器人

GPT-4最全攻略来袭!OpenAI官方发布,六个月攒下来的使用经验都在里面了

携程发布旅游行业垂直大模型 梁建章:AI策略是做可靠的内容 放心的推荐

山东机器人编程:Scratch编程基础,认识舞台!~济南机器人编程

国产工业机器人领域“暗潮涌动”,即将迎来新一轮复苏

令人惊叹!AI模型能够以iPhone照片为基础创作诗歌

微软大牛加入ZOOM,AI人才大战打响

高通发布长期产品计划,为工业和企业物联网产品提供全新组合方案

人工智能在重症监护室的未来

AI无法对传统文化符号进行解构和创新

7条线路感受智慧美好生活,“2025 世界人工智能大会民营企业社会开放日”主题活动启动

智能客服进入AI 2.0时代 容联云发布语言大模型“赤兔”

焊接协作机器人或将成为26届埃森展最大看点

卫星通信牵引物联网竞争升维,模组厂商如何决胜百亿市场?

Meta Quest订阅服务每月7.99美元畅玩两款VR游戏应用

VR健身应用《FitXR》将取消Quest 1端会员服务

全新“AI助手”!讯飞星火助手中心人机协作共创新生态

AI会帮我们把活干完吗?

AI取代人工先拿教育行业开刀?美版“作业帮”启动裁员

英特尔张宇:边缘计算在整个AI生态系统中扮演重要角色

GPT-4 模型架构泄露:包含 1.8 万亿参数、采用混合专家模型

发布最新版本的 PICO OS 5.7.0:支持VR头盔录屏并跨平台分享至微信

比尔盖茨:AI确实存在风险,但可控

AI绘画,还需要懂数学?

这效果能打几分?AI真人化《名侦探柯南》

深企派遣无人机救援队赴京津冀开展防汛救灾任务

美图秀秀“AI 扩图”功能上线,可根据图像生成更大画幅

配 3D 机器人头像,谷歌展示全新安卓 LOGO

北京公司实施AI技术,推行4.5天工作制,抵制996文化,提升员工工作幸福感

真全息产品,亮相深圳文博会——dipal数伴拓展元宇宙非沉浸式体验

人工智能在商业中的风险和局限性

鹅厂机器狗抢起真狗「饭碗」!会撒欢儿做游戏,遛人也贼6

2025年深圳举办的SUSECON 创新峰会开始接受报名

塑造全能智能管家:华为小艺AI加成应对大模型挑战

Dubbo负载均衡策略之 一致性哈希

基于信息论的校准技术,CML让多模态机器学习更可靠

官宣!爱康AI未来之夜三大亮点提前剧透!

消息称苹果 iPhone 15 系列健康应用将深度融合 AI 技术

电力人工智能数据集目录首次发布

腾讯机器狗进化:通过深度学习掌握自主决策能力

对话式论文阅读工具PaperMate上线,综述细节AI告诉你

“世界人工智能之都”的新烦恼:AI热潮无法拉动大量就业

编程已死,AI 当立?教授公开“唱反调”:AI 还帮不了程序员

花16000元买四款扫拖机器人!科沃斯追觅石头小米谁能笑到最后?

AI成政客博弈工具,美国大选真假难辨,律师们的生意来了