发布时间:2025-06-20

发布时间:2025-06-20 点击次数:

点击次数: 随着人工智能技术的迅猛发展,ai作画逐渐成为了艺术领域的一股新兴力量。ai作画不仅突破了传统绘画的局限,还为我们带来了全新的艺术体验。本文将详细解析ai作画的原理及相关理论,并通过代码示例展示其实现过程。

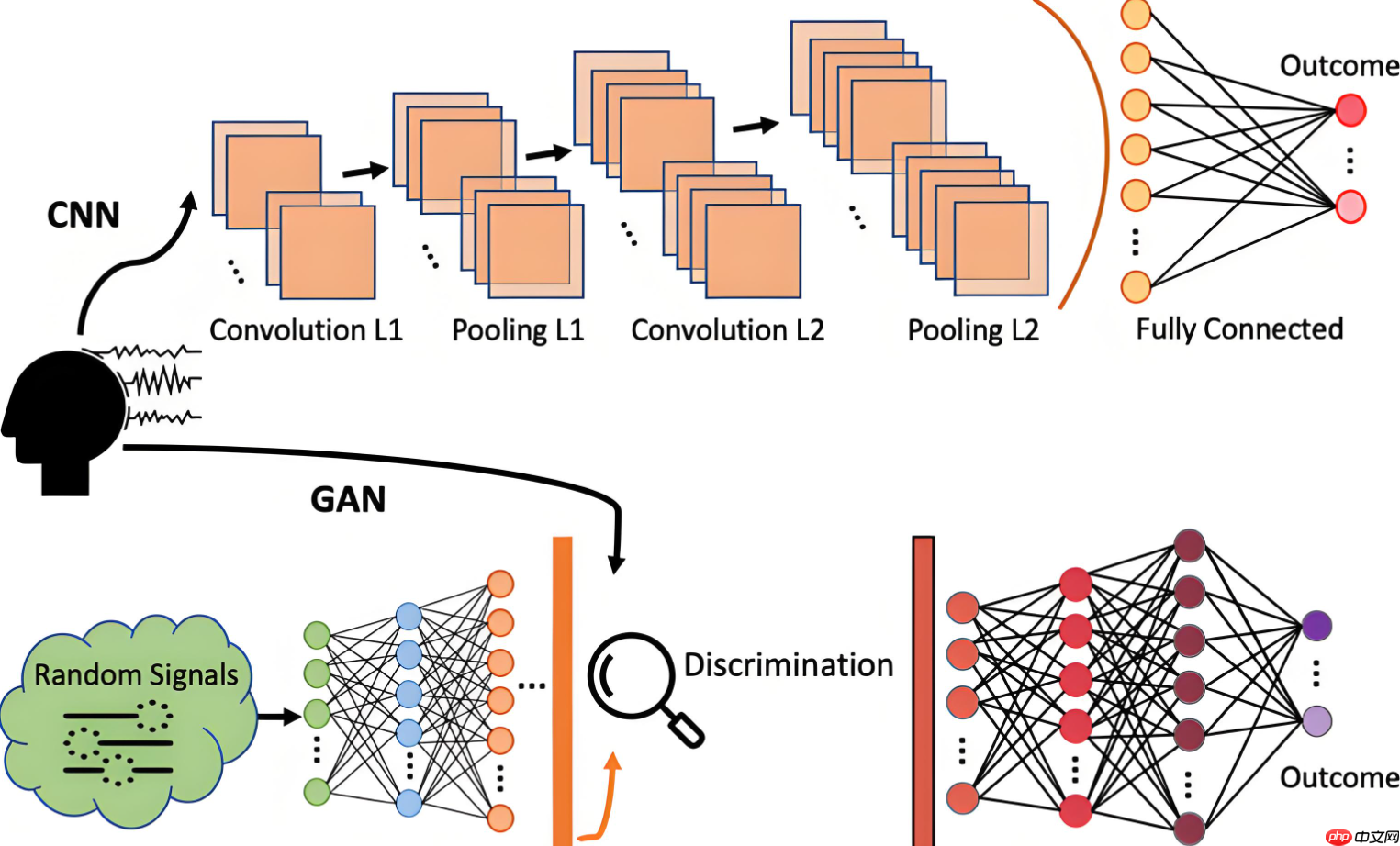

AI作画主要依赖于深度学习技术,特别是卷积神经网络(CNN)。CNN通过模拟人脑视觉系统的层次结构,从原始图像中提取出多层次、多尺度的特征信息。在AI作画中,CNN被用于学习大量艺术作品的风格和内容,从而生成具有特定风格的新作品。

具体来说,AI作画的过程可以分为以下几个步骤:

风格迁移是AI作画的核心理论之一。它基于神经网络的特征表示能力,将一幅图像的内容和另一幅图像的风格进行融合。具体来说,风格迁移算法通过计算内容损失和风格损失来优化生成图像。内容损失衡量生成图像与原始图像在内容上的相似度,而风格损失则衡量生成图像与目标风格在风格上的相似度。通过调整这两个损失的权重,可以实现不同风格强度的迁移。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

GAN是另一种重要的AI作画理论。它由生成器和判别器两个神经网络组成,通过相互对抗的方式进行训练。生成器的任务是生成尽可能真实的图像,而判别器的任务则是判断输入的图像是来自真实数据集还是由生成器生成的。通过不断优化这两个网络,GAN可以生成高质量、多样化的艺术作品。

下面是一个简单的AI作画代码示例,使用TensorFlow和Keras库实现风格迁移。

超漂亮的淘宝客商城网源码

超漂亮的淘宝客商城网源码

淘宝商品推广,店铺推广及管理功能。淘宝商品,店铺一键更换PID.淘宝搜索推广代码,合作标示代码均在后台添加.客户注册与否均可购物、留言、评论、发送站内消息。取回密码功能。会员密码及取回密码的答案均以MD5加密,确保安全。发送站内消息自动附加原文,并以不同颜色区分原文。管理员可发送公共消息,可查看会员是否阅读或删除管理员发送的消息。后台“会员管理”中可查看会员

0

查看详情

0

查看详情

首先,安装必要的库:

pip install tensorflow keras opencv-python numpy matplotlib |

然后,编写风格迁移的代码:

import tensorflow as tf from tensorflow.keras.applications import vgg19 from tensorflow.keras.preprocessing import image from tensorflow.keras.applications.vgg19 import preprocess_input, decode_predictions import numpy as np import matplotlib.pyplot as plt # 加载预训练模型 model = vgg19.VGG19(include_top=False, weights='imagenet') # 加载内容图像和风格图像 content_image_path = 'path_to_content_image.jpg' style_image_path = 'path_to_style_image.jpg' # 加载并预处理图像 def load_and_process_image(image_path): img = image.load_img(image_path, target_size=(512, 512))img_tensor = image.img_to_array(img) img_tensor = np.expand_dims(img_tensor, axis=0) img_tensor = preprocess_input(img_tensor) return img_tensor content_image = load_and_process_image(content_image_path) style_image = load_and_process_image(style_image_path) # 定义内容损失和风格损失函数 def content_loss(base_content, target): return tf.reduce_mean(tf.square(base_content - target)) def gram_matrix(input_tensor): channels = int(input_tensor.shape[-1]) a = tf.reshape(input_tensor, [-1, channels]) n = tf.shape(a)[0] gram = tf.matmul(a, a, transpose_a=True) return gram / tf.cast(n, tf.float32) def style_loss(style, combination): S = gram_matrix(style) C = gram_matrix(combination) channels = 3 size = img_height * img_width return tf.reduce_sum(tf.square(S - C)) / (4. * (channels ** 2) * (size ** 2)) # 提取特征图 def extract_features(tensor, model): layers_dict = dict([(layer.name, layer.output) for layer in model.layers]) feature_layers = ['block1_conv1', 'block2_conv1', 'block3_conv1', 'block4_conv1', 'block5_conv1'] features = [layers_dict[layer].name for layer in feature_layers] model_outputs = [model.get_layer(name).output for name in features] feature_extractor = tf.keras.models.Model(inputs=model.input, outputs=model_outputs) return feature_extractor(tensor) # 提取内容图像和风格图像的特征 content_outputs = extract_features(content_image, model) style_outputs = extract_features(style_image, model) # 定义损失函数 def compute_loss(model, base_input, gram_style_features, content_weight, style_weight, total_variation_weight): model_outputs = model(base_input) style_output_features = model_outputs[:len(gram_style_features)] content_output_features = [model_outputs[len(gram_style_features)]] style_score = 0 content_score = 0 # 计算风格损失 weight_per_style_layer = 1.0 / float(len(style_layers)) for target_style, comb_style in zip(gram_style_features, style_output_features): style_score += weight_per_style_layer * style_loss(target_style[0], comb_style[0]) # 计算内容损失 content_score += content_weight * content_loss(content_output_features[0][0], content_outputs[0]) # 计算总变差损失(可选) if total_variation_weight: x_rows = base_input.get_shape().as_list() x_cols = base_input.get_shape().as_list() a = tf.square(base_input[:, :x_rows-1, :x_cols-1, :] - base_input[:, 1:, :x_cols-1, :]) b = tf.square(base_input[:, :x_rows-1, :x_cols-1, :] - base_input[:, :x_rows-1, 1:, :]) total_variation = tf.reduce_sum(tf.pow(a + b, 1.25)) total_variation_loss = total_variation_weight * total_variation return content_score + style_score + total_variation_loss else: return content_score + style_score # 梯度下降过程 import tensorflow.keras.backend as K def eval_loss_and_grads(model, x, y, gram_style_features, content_weight, style_weight, total_variation_weight): x = tf.constant(x) y = tf.constant(y) with tf.GradientTape() as tape: loss_value = compute_loss(model, x, gram_style_features, content_weight, style_weight, total_variation_weight) grad = tape.gradient(loss_value, x) return loss_value, grad # 风格迁移过程 num_iterations = 1000 content_weight = 1e3 style_weight = 1e-2 total_variation_weight = 1e-4 x = tf.Variable(content_image) gram_style_features = extract_features(style_image, model) # 运行风格迁移 optimizer = tf.optimizers.Adam(learning_rate=5, beta_1=0.99, epsilon=1e-1) for i in range(num_iterations): loss_value, grads = eval_loss_and_grads(model, x, y, gram_style_features, content_weight, style_weight, total_variation_weight) optimizer.apply_gradients([(grads, x)]) if i % 100 == 0: print('Iteration %d: %d, Loss: %.2f' % (i, loss_value)) # 获取最终的迁移图像 output_image = x.numpy() output_image = output_image.reshape((img_height, img_width, 3)) output_image = output_image * 255.0 output_image = np.clip(output_image, 0, 255).astype('uint8') # 保存迁移图像 ims*e('style_transferred_image.png', output_image) # 显示迁移图像 plt.imshow(output_image) plt.show()

代码是一个简化版的风格迁移过程,可能需要根据实际使用的模型和图像进行适当调整。同时,由于计算量较大,运行风格迁移可能需要一定的时间。

1. 使用更高效的优化器。

2. 调整权重参数以平衡内容损失和风格损失。

3. 尝试不同的预训练模型以获得不同的风格效果。

4. 使用更复杂的图像预处理和后处理技术来提升迁移图像的质量。

风格迁移是一种将一幅图像的风格迁移到另一幅图像内容上的技术。通过构建计算内容损失和风格损失的函数,并使用梯度下降法优化损失函数,我们可以实现风格迁移。上述代码提供了一个基本的实现框架,但具体的实现方式可能因使用的模型和图像而有所不同。

以上就是AI作画原理及相关理论(附代码示例)的详细内容,更多请关注其它相关文章!

# 后处理

# 贵州网站推广招商

# 温州抖音seo招商

# 新沂网络网站建设哪家好

# 获客网站优化方法

# 线下营销推广方式与合作

# 新乡关键词营销推广外包

# 深圳网站推广徽hyhyk1

# 工业园网站优化服务

# 曲靖抖音seo视频优化

# 关掉网站推广项目

# 一幅

# 加载

# ai作画

# 这两个

# 艺术作品

# 站内

# 是一个

# 滤镜

# 淘宝

# type

# 征信

# red

# ai

# python

相关栏目:

【

行业新闻62819 】

【

科技资讯67470 】

相关推荐:

乐天派AI桌面机器人提供的正能量情绪价值直接拉满,妥妥的治愈系

国内阅读行业首款对话式AI应用“阅爱聊”封闭内测

全国体育人工智能大会举办,专家聚焦体育人工智能领域人才培养

特斯拉首发人形机器人“擎天柱”亮相世界人工智能大会

280万条多模态指令-响应对,八种语言通用,首个涵盖视频内容的指令数据集MIMIC-IT来了

郭帆:AI发展日新月异,或是弯道超车好莱坞的最好机会

谷歌将使用公开信息训练 AI 模型,构建更强大的自家产品

人工智能即将进入Windows:企业准备好安全策略设置了吗?

世界水下机器人大赛:9国青年携手逐梦深蓝

旷视入选北京市通用人工智能产业创新伙伴计划

“苏南 vs 苏北” AI 分胜负,娱乐性比较工具 EitherChoice 上线

华为将于 7 月发布面向 AI 大模型的新款存储产品

即时 AI再次升级 30秒生成自带动效的网页 生成速度提升100%

闪电快讯|京东推出言犀AI大模型 面向零售、医疗、物流等产业场景

30+大模型齐聚,大模型成世界人工智能大会“顶流”

深圳人工智能企业超1900家

郭帆导演成功利用AI技术制作的《流浪地球3》预告片在央视热播,引发巨大反响

技术如何使人变得懒惰?

机器人加速!稀土永磁也被带火,持续性如何?

机器人 展才能

全面拥抱大模型浪潮,ISC 2025打造全球首场AI数字安全峰会

《上古卷轴5》AI高清材质包优化游戏中所有怪物

AI生成新闻网站数量激增,正在疯狂赚取广告收入

世界人工智能大会(WAIC 2025)点燃魔都,博尔捷数字科技携前沿技术产品亮相

V社谈AI制作游戏被ban:为确保开发者有素材所有权

苹果公司迅速拓展AR/VR团队,Vision Pro发布后7月份增设近100份工作机会

原小米 9 号员工李明打造全球首款 AI 安卓桌面机器人

有 ARM 和 X86 两个版本,香橙派游戏掌机细节曝光

在这里见未来!杭州未来科技城全球AI盛会邀您共探最前沿

华为推出全新操作系统HarmonyOS 4,AI和新引擎完美融合

视觉中国推出AI灵感绘图功能

马斯克的幽默“现实”:AR眼镜与20美元“增强现实”哪个真实?

“一般智力”与工艺学批判是认识AI的重要入口 | 社会科学报

人工智能领域,突破难题:国产大模型“无源之水”问题得到解决。

梦想实现!硬核科幻大片VR智能头盔即将问世

Meta发布语音AI模型 Voicebox 助虚拟助手与NPC对话

值得买科技入选“北京市通用人工智能产业创新伙伴计划”应用伙伴

重塑未来生活的五项技术趋势

超级智能到底是什么?

周鸿祎参加中美青年科技创新峰会,分享人工智能创新机遇

《自然》杂志拒绝刊登人工智能生成的图片和视频

英伟达CEO宣称生成式AI已迎来“划时代时刻”

令人惊叹!AI模型能够以iPhone照片为基础创作诗歌

2025VR&AR显示技术峰会视频解析: 歌尔光学展示最新一代VR/AR光学模组

洞穴探险神器?可自主导航的单旋翼自旋无人机,效率更高!

世界人工智能大会|“AI领航,共筑未来”高端保险论坛成功举办

马斯克称人类是半机器人,记忆外包给了电脑

人工智能写作检测工具不靠谱,美国宪法竟被认为是机器人写的

马斯克嘲讽人工智能:机器学习本质就是统计学

扎克·施奈德新片《月球叛军》曝剧照 机器人首度现身