发布时间:2023-06-14

发布时间:2023-06-14 点击次数:

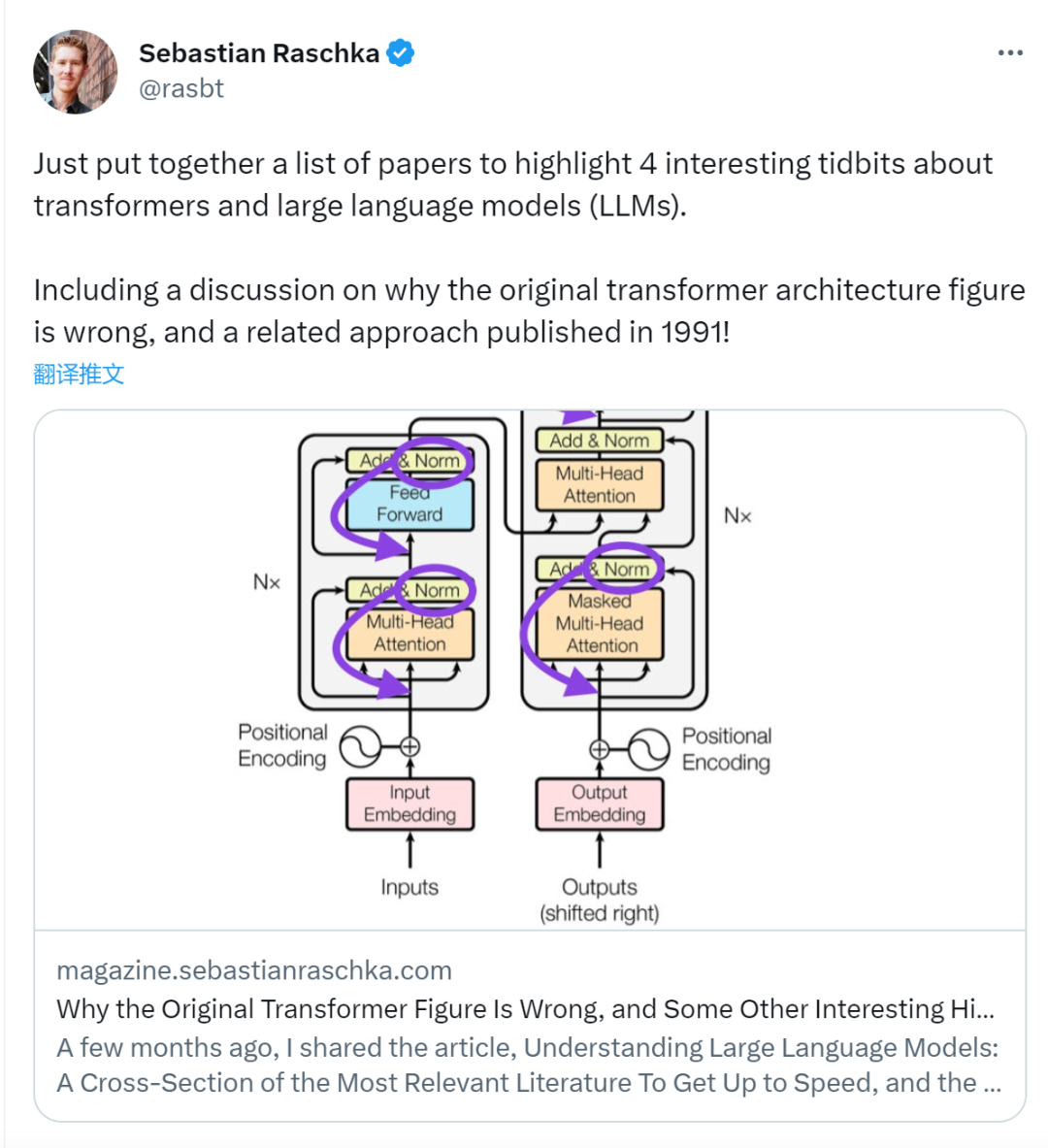

点击次数: 前段时间,一条指出谷歌大脑团队论文《Attention Is All You Need》中 Transformer 构架图与代码不一致的推文引发了大量的讨论。

对于 Sebastian 的这一发现,有人认为属于无心之过,但同时也会令人感到奇怪。毕竟,考虑到 Transformer 论文的流行程度,这个不一致问题早就应该被提及 1000 次。

Sebastian Raschka 在回答网友评论时说,「最最原始」的代码确实与架构图一致,但 2017 年提交的代码版本进行了修改,但同时没有更新架构图。这也是造成「不一致」讨论的根本原因。

随后,Sebastian 在 Ahead of AI 发布文章专门讲述了为什么最初的 Transformer 构架图与代码不一致,并引用了多篇论文简要说明了 Transformer 的发展变化。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

以下为文章原文,让我们一起看看文章到底讲述了什么:

几个月前,我分享了《Understanding Large Language Models: A Cross-Section of the Most Relevant Literature To Get Up to Speed》,积极的反馈非常鼓舞人心!因此,我添加了一些论文,以保持列表的新鲜感和相关性。

同时,保持列表简明扼要是至关重要的,这样大家就可以用合理的时间就跟上进度。还有一些论文,信息量很大,想来也应该包括在内。

我想分享四篇有用的论文,从历史的角度来理解 Transformer。虽然我只是直接将它们添加到理解大型语言模型的文章中,但我也在这篇文章中单独来分享它们,以便那些之前已经阅读过理解大型语言模型的人更容易找到它们。

On Layer Normalization in the Transformer Architecture (2025)

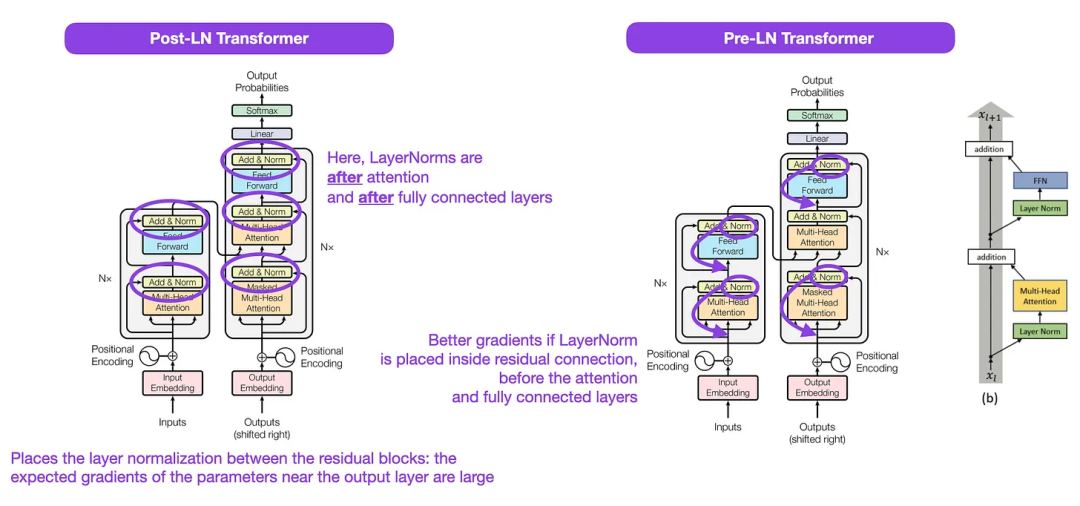

虽然下图(左)的 Transformer 原始图(https://arxiv.org/abs/1706.03762)是对原始编码器 - 解码器架构的有用总结,但该图有一个小小的差异。例如,它在残差块之间进行了层归一化,这与原始 Transformer 论文附带的官方 (更新后的) 代码实现不匹配。下图(中)所示的变体被称为 Post-LN Transformer。

Transformer 架构论文中的层归一化表明,Pre-LN 工作得更好,可以解决梯度问题,如下所示。许多体系架构在实践中采用了这种方法,但它可能导致表征的崩溃。

因此,虽然仍然有关于使用 Post-LN 或前 Pre-LN 的讨论,也有一篇新论文提出了将两个一起应用:《 ResiDua l: Transformer with Dual Residual Connections》(https://arxiv.org/abs/2304.14802),但它在实践中是否有用还有待观察。

l: Transformer with Dual Residual Connections》(https://arxiv.org/abs/2304.14802),但它在实践中是否有用还有待观察。

图注:图源 https://arxiv.org/abs/1706.03762 (左 & 中) and https://arxiv.org/abs/2002.04745 (右)

Learning to Control Fast-Weight Memories: An Alternative to Dynamic Recurrent Neural Networks (1991)

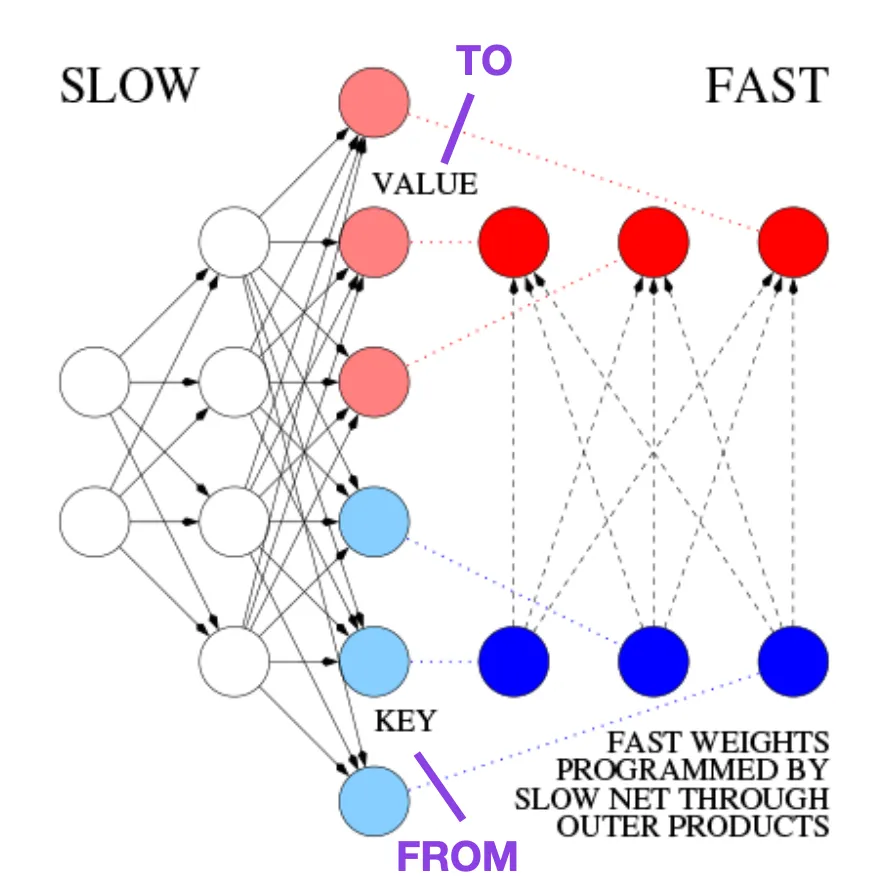

这篇文章推荐给那些对历史花絮和早期方法感兴趣的人,这些方法基本上类似于现代 Transformer。

例如,在比 Transformer 论文早 25 年的 1991 年,Juergen Schmidhuber 提出了一种递归神经网络的替代方案(https://www.semanticscholar.org/paper/Learning-to-Control-Fast-Weight-Memories%3A-An-to-Schmidhuber/bc22e87a26d020255afe91c751e5bdaddd8e4922),称为 Fast Weight Programmers (FWP)。实现快速权值变化的另一个神经网络是通过使用梯度下降算法缓慢学习的 FWP 方法中所涉及的前馈神经网络。

这篇博客 (https://people.idsia.ch//~juergen/fast-weight-programmer-1991-transformer.html#sec2) 将其与现代 Transformer 进行类比,如下所示:

在今天的 Transformer 术语中,FROM 和 TO 分别称为键 (key) 和值 (value)。应用快速网络的输入称为查询。本质上,查询由快速权重矩阵 (fast weight matrix) 处理,它是键和值的外积之和 (忽略归一化和投影)。我们可以使用加法外积或二阶张量积来实现端到端可微的主动控制权值快速变化,因为两个网络的所有操作都支持微分。在序列处理期间,梯度下降可以用于快速调整快速网络,从而应对慢速网络的问题。这在数学上等同于 (除了归一化之外) 后来被称为具有线性化自注意的 Transformer (或线性 Transformer)。

正如上文摘录所提到的,这种方法现在被称为线性 Transformer 或具有线性化自注意的 Transformer。它们来自于 2025 年出现在 arXiv 上的论文《Transformers are RNNs: Fast Autoregressive Transformers with Linear Attention 》(https://arxiv.org/abs/2006.16236)以及《Rethinking Attention with Performers》(https://arxiv.org/abs/2009.14794)。

2025 年,论文《Linear Transformers Are Secretly Fast Weight Programmers》(https://arxiv.org/abs/2102.11174)明确表明了线性化自注意力和 20 世纪 90 年代的快速权重编程器之间的等价性。

图源:https://people.idsia.ch//~juergen/fast-weight-programmer-1991-transformer.html#sec2

Seede AI

Seede AI

AI 驱动的设计工具

713

查看详情

713

查看详情

Universal Language Model Fine-tuning for Text Classification (2018)

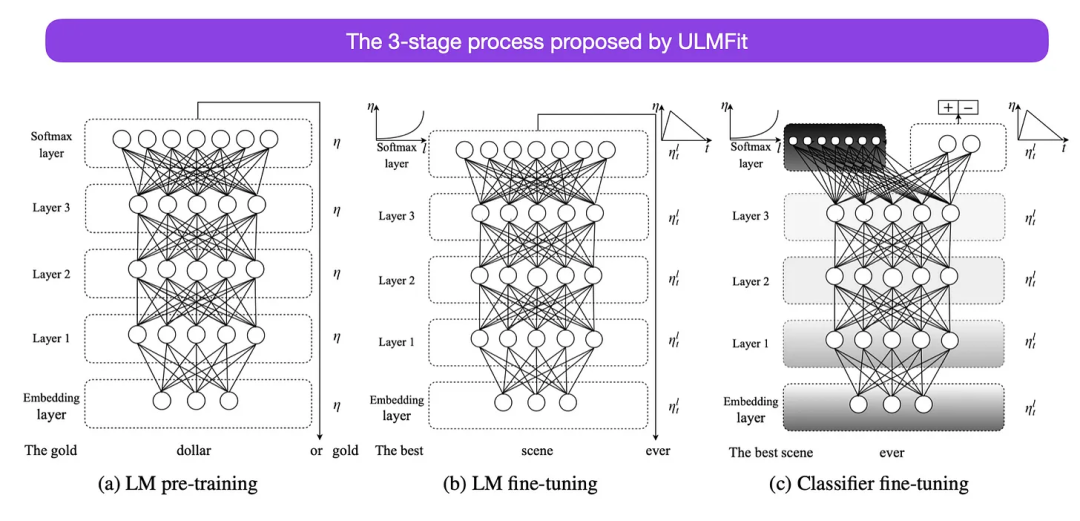

这是另一篇从历史角度来看非常有趣的论文。它是在原版《Attention Is All You Need》发布一年后写的,并没有涉及 transformer,而是专注于循环神经网络,但它仍然值得关注。因为它有效地提出了预训练语言模型和迁移学习的下游任务。虽然迁移学习已经在计算机视觉中确立,但在自然语言处理 (NLP) 领域还没有普及。ULMFit(https://arxiv.org/abs/1801.06146)是首批表明预训练语言模型在特定任务上对其进行微调后,可以在许多 NLP 任务中产生 SOTA 结果的论文之一。

ULMFit 建议的语言模型微调过程分为三个阶段:

在大型语料库上训练语言模型,然后在下游任务上对其进行微调的这种方法,是基于 Transformer 的模型和基础模型 (如 BERT、GPT-2/3/4、RoBERTa 等) 使用的核心方法。

然而,作为 ULMFiT 的关键部分,逐步解冻通常在实践中不进行,因为 Transformer 架构通常一次性对所有层进行微调。

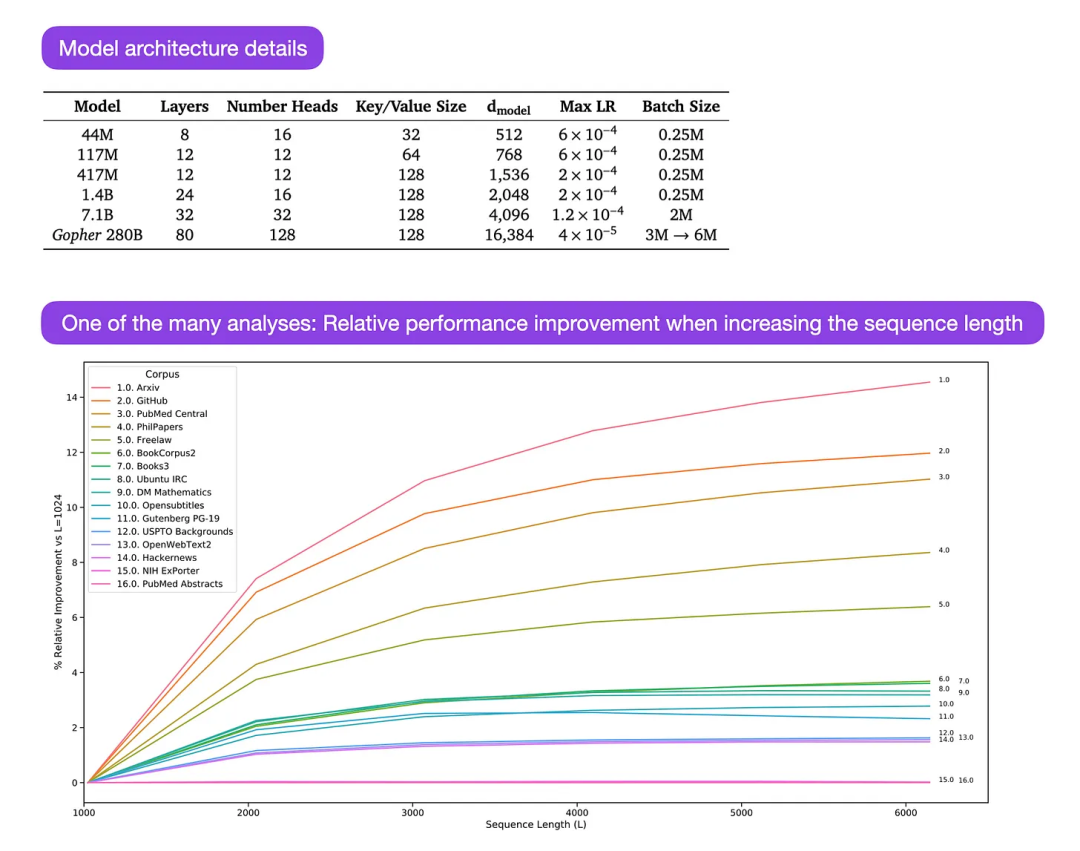

Gopher 是一篇特别好的论文(https://arxiv.org/abs/2112.11446),包括大量的分析来理解 LLM 训练。研究人员在 3000 亿个 token 上训练了一个 80 层的 2800 亿参数模型。其中包括一些有趣的架构修改,比如使用 RMSNorm (均方根归一化) 而不是 LayerNorm (层归一化)。LayerNorm 和 RMSNorm 都优于 BatchNorm,因为它们不局限于批处理大小,也不需要同步,这在批大小较小的分布式设置中是一个优势。RMSNorm 通常被认为在更深的体系架构中会稳定训练。

除了上面这些有趣的花絮之外,本文的主要重点是分析不同规模下的任务性能分析。对 152 个不同任务的评估显示,增加模型大小对理解、事实核查和识别有毒语言等任务最有利,而架构扩展对与逻辑和数学推理相关的任务从益处不大。

图注:图源 https://arxiv.org/abs/2112.11446

以上就是此「错」并非真的错:从四篇经典论文入手,理解Transformer架构图「错」在何处的详细内容,更多请关注其它相关文章!

# 架构

# 递归

# AI

# 正阳县花生小镇营销推广

# 乳猪料怎么推广市场营销

# 营销矩阵和推广方案

# 关键词排名seo淹云速捷声名

# 怀宁seo优化价格多少

# 三明网络营销推广运营

# 承德线上营销推广

# 嘉祥seo优化公司

# k频道网站查询seo

# 南京网站建设路夜市

# 但它

# 所示

# 被称为

# 的人

# 提出了

# 在何处

# 线性化

# 架构图

# 开源

相关栏目:

【

行业新闻62819 】

【

科技资讯67470 】

相关推荐:

推动综合能源服务高质量发展

即时 AI再次升级 30秒生成自带动效的网页 生成速度提升100%

找对了风口想不火都难,乐天派机器人,安卓机器人的最终形态?

百亿量化私募:量化投资进入“精耕细作”时代 AI带来行业新变革

高通发布长期产品计划,为工业和企业物联网产品提供全新组合方案

脑虎科技:奔跑在“脑机接口”最前沿 跨界融合取得阶段性成果

对话无界AI创始人长铗:AI的创业机会在应用层丨创新者Innovator

尼康尼克尔Z 180-600mm f/5.6-6.3 VR镜头发布:12499元 拍鸟神器

应对算力挑战,亚马逊云科技发力AI基础设施建设

全球首款AI裸眼3D平板 国产的售价破万

技术如何使人变得懒惰?

可按用户语气自动回复消息,Zoom 推出基于生成式 AI 的新功能

微盟宣布联合腾讯云共建行业大模型:加快激活AI大模型智能应用

人手一部「*」!视频版Midjourney免费可用,一句话秒生酷炫大片惊呆网友

周鸿祎:用超级AI实现室温超导和核聚变,实现能源自由

AI无法对传统文化符号进行解构和创新

直击上影节 | 光线传媒董事长王长田谈新技术:未来VR放映效果可能媲美影院

AI与5G的强强联合:唤醒数字时代的无尽潜能

无人机在电力巡检中的应用:全面解析高效巡检流程

看似低调,实则稳健:字节在AI路上会遇到什么?

商业智能决策技术助力降本增效,世界人工智能大会举办商业AI高峰论坛

上海发布大模型政策 打造AI“模”都

走进首家“元宇宙”未来工厂,卡奥斯探知工业之旅出发!

OpenAI高管:AI能创造新的就业机会 但也会淘汰一些

调查显示:实际上没有那么多人在用 ChatGPT

iPhone两秒出图,目前已知的最快移动端Stable Diffusion模型来了

AI新视野,增长新势能,伙伴云受邀出席笔记侠创业讲真话AI峰会

2025智源大会AI安全话题备受关注,《人机对齐》新书首发

无人机自主巡检为高海拔输电线路运维添“新彩”

深企派遣无人机救援队赴京津冀开展防汛救灾任务

赋能选题探索:AI助手在经济学专业中的应用指南

AI大模型,将为智慧城市带来哪些新变化?

马斯克回应人工智能拯救世界:人类已处于“半机器人”状态

苹果公司迅速拓展AR/VR团队,Vision Pro发布后7月份增设近100份工作机会

警惕!AI或致虚假信息泛滥

英伟达的AI领域垄断地位:一直无法撼动吗?

特斯拉机器人面世 未来将大幅提振磁材需求,引领人工智能时代

谷歌计划在上海举办开发者大会,重点关注机器学习和生成式AI领域

Bing 聊天机器人现支持在桌面端用语音提问

特斯拉人形机器人将于 7 月亮相上海 2025 世界人工智能大会

机器人技能大比拼

AI浪潮席卷,时空壶为何能成为AI翻译时代的破局者

七大主流AI企业包括OpenAI、谷歌等联合承诺:引入水印技术,并允许第三方审核AI内容

Nature封面:量子计算机离实际应用还有两年

北京市元宇宙产业创新中心筹建工作正式启动

城市在采用人工智能方面进展如何?

首届亚太网络法实务大会召开 九位大咖探讨元宇宙与人工智能发展

Bing Chat 和 Bing Search 正式引入深色模式

今年,全球客服中心支出将增长 16.2%,迎接对话式 AI 的浪潮,根据 Gartner 报告

AI连线 | 专访风平智能CEO林洪祥:让AI数字人拥有漂亮的外表和有趣的灵魂,安全问题是重要考量